2. 广州市医用放射成像与检测技术重点实验室,广东 广州 510515

2. Guangzhou Key Laboratory of Medical Radiation, Imaging and Detection Technology, Guangzhou 510515, China

医用X射线CT能够精确重建出人体的三维解剖断层图像, 是临床检查中常用的医学成像手段。随着CT的广泛应用, 扫描过程中辐射对受检者的影响也越来越受人关注[1]。近年来, 如何在满足临床影像诊断要求的条件下降低X射线辐射剂量一直都是CT成像领域的研究热点[2-3]。本文主要关注基于稀疏角度的低剂量CT成像方法, 即在扫描时通过减少采集的投影数量[4]来减少辐射剂量。稀疏角度成像具有加速数据采集的优点, 同时能够减少球管曝光时间, 降低X-ray球管的损耗, 降低成本。然而, 稀疏角度CT因为投影数据量不足, 常规滤波反投影算法(FBP)重建得到的图像伴有明显的噪声和条形伪影, 严重影响组织结构的识别[5-6]。针对稀疏角度CT图像的伪影问题, 现有的研究方法主要可以分为三类:第一类是弦图恢复[7], 即通过不同方法填充缺失角度对应的弦图数据, 再采用FBP算法重建图像。例如Li等[8]提出了一种基于字典学习的弦图恢复方法, 采用K-SVD算法[9]构建的CT数据库对缺失的弦图数据进行补全。该数据库由完整CT图像对应的弦图块组成, 稀疏角度弦图恢复的效果与数据库构建的完备性和多样性相关。第二类是统计迭代重建[10-11], 即在构建迭代模型时, 将投影数据的统计特性和图像先验知识融入到统一的框架之中。例如Kim等[12]提出利用图像中的全局信息, 采用非均匀加权惩罚的再加权非局部全变分(R-NLTV)算法重建稀疏角度图像。这类基于模型的迭代重建算法需要经过多次迭代才能得到较好的重建结果, 重建过程非常耗时。第三类是传统的图像后处理算法, 即在图像域上处理常规FBP重建的稀疏角度图像的噪声和伪影问题。例如考虑图像特征的局部相似性, 采用非局部均值(NLM)算法去伪影[13]。但是图像域噪声统计特性复杂, 并且对于复杂结构的伪影刻画困难, 因此采用传统图像后处理方法得到的图像降噪去伪影效果一般。

目前深度学习[14-16](DL)作为一种高效的算法工具, 越来越多地用于解决CT成像中的噪声和伪影问题。例如KyongHwan采用FBP卷积神经网络(FBPConvNet)解决稀疏角度CT重建存在高噪声强伪影等病态逆问题[17]; Hu提出残差编码-解码卷积神经网络(REDCNN)用于恢复低剂量CT重建图像的分辨率[18]。尽管这些深度学习方法都在一定程度上提高了稀疏角度CT的重建图像质量, 但是他们考虑的都是二维平行束的扫描几何(区别于临床中常用的螺旋扫描几何)。因此, 这些方法无法直接应用于临床螺旋CT数据。

为了解决上述问题, 本文提出将小波分解与残差网络相结合[19-20]的多尺度小波残差网络(MWResNet), 同时采用真实的螺旋几何CT稀疏角度图像数据进行网络训练, 实现稀疏角度CT图像的恢复。对比实验中, 通过对比仿真二维平行束稀疏角度训练的FBPConvNet和REDCNN网络, 以及一个同样用真实的螺旋几何数据实现低剂量CT图像恢复[21]的迭代残差卷积网络(IRLNet)的图像恢复结果。通过对不同网络的恢复图像对比和定量分析表明, 本文网络输出的图像噪声显著减少, 伪影明显消除, 同时能有效保持组织结构信息, 得到高分辨率的恢复图像。

1 方法 1.1 方法概述本文提出的MWResNet网络, 利用网络中的多参数构建一个高噪声强伪影的输入图像到噪声抑制、伪影消除的输出图像的映射函数, 实现稀疏角度CT低分辨率图像的恢复。

令X ∈ Rm × n表示在稀疏角度投影数据下利用FBP算法重建得到的低分辨率CT图像, Y ∈ Rm × n为与其对应的在全角度投影数据下利用FBP算法重建得到的无伪影高分辨率CT图像, 它们之间的关系表示为:

| $ X = \sigma \left( Y \right) $ | (1) |

其中σ:Rm × n → Rm × n 表示由噪声及投影角度缺失造成的退化函数。在深度学习框架下, 从x到y的映射可表示为[22]:

| $ y = F(\Theta , x) = {f_n}({W_n}{f_{n - 1}}( \cdots ({W_2}{f_1}({W_1}x + {b_1}) + {b_2}) \cdots ) + {b_n}) $ | (2) |

式中x是输入, y是输出, Wi是第i个卷积层参数矩阵, bi是该卷积层对应的偏置项, fi为一个非线性激活函数, 常用的非线性激活函数有线性整流单元(ReLU), Θ表示整个神经网络F中包含的参数。借助于神经网络能表达各种映射函数的能力[23], 通过数据训练以找到一组特定网络参数

| $ \begin{array}{*{20}{c}} \rm{arg\;min}\\ f \end{array}\left\| {F(\tilde \Theta , X) - Y} \right\|_2^2 $ | (3) |

使得输入的稀疏角度CT图像X经过该网络的映射能尽可能地接近于全角度投影重建得到图像Y, 以实现稀疏角度图像的恢复。

1.2 多尺度小波残差网络(MWResNet)框架本文MWResNet网络的主要特点是在网络中将残差块结构与离散小波变换(DWT)及其逆变换(IWT)结合, 采用层数更深的网络来实现图像中不同频率特征的提取和映射。

1.2.1 小波变换及其逆变换MWResNet网络通过DWT实现输入图像的分解[24], 得到包含不同频率结构信息的特征图像。特征图像再经过网络块进行特征提取和映射, 最后对网络块的输出采用IWT进行融合得到恢复图像。

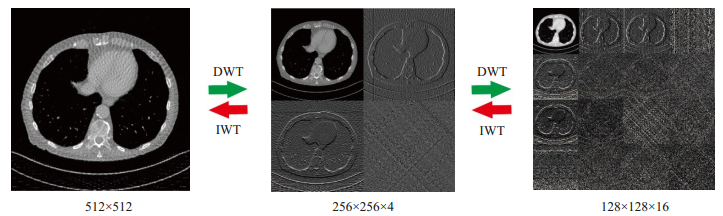

图 1所示DWT和IWT实现图像的分解与融合示意图。本文MWResNet网络中采用二维Haar小波作为DWT和IWT的小波基函数, 其对应的滤波器为:

| $ \begin{array}{l} \;\;\;\;{\psi _{LL}} = \left[ {\begin{array}{*{20}{c}} 1&1\\ 1&1 \end{array}} \right], \;\;\;\;\;\;\;{\psi _{LH}} = \left[ {\begin{array}{*{20}{c}} { - 1}&{ - 1}\\ 1&1 \end{array}} \right], \;\;\;\;\;\;\;\;\;{\psi _{HL}} = \left[ {\begin{array}{*{20}{c}} { - 1}&1\\ { - 1}&1 \end{array}} \right], \\ {\psi _{HH}} = \left[ {\begin{array}{*{20}{c}} 1&{ - 1}\\ { - 1}&1 \end{array}} \right] \end{array} $ | (4) |

|

图 1 单幅图像进行DWT分解降采样和IWT融合升采样 Fig.1 DWT decomposition down-sampling and IWT fusion up-sampling for a single image. |

DWT实现图像分解, 是利用四个滤波器ψLL, ψLH, ψHL, ψHH分别与图像Xi进行卷积[25], 得到四个表示不同频率结构信息的降采样子带图像xi, 1, xi, 2, xi, 3, xi, 4:

| $ DWT\left\{ {\begin{array}{*{20}{c}} {{x_{i, 1}} = {X_i} \otimes {\psi _{LL}}}\\ {{x_{i, 2}} = {X_i} \otimes {\psi _{LH}}}\\ {{x_{i, 3}} = {X_i} \otimes {\psi _{HL}}}\\ {{x_{i, 4}} = {X_i} \otimes {\psi _{HH}}} \end{array}} \right. $ | (5) |

小波逆变换IWT, 则是在图像特定位置将子带特征图像进行组合运算, 实现图像的融合升采样:

| $ IWT\left\{ {\begin{array}{*{20}{l}} {{X_i}(1:2: \mathit{row} , 1:2: \mathit{col} ) = ({x_{i, 1}} - {x_{i, 2}} - {x_{i, 3}} + {x_{i, 4}})/2}\\ {{X_i}(1:2: \mathit{row} , 2:2: \mathit{col} ) = ({x_{i, 1}} + {x_{i, 2}} - {x_{i, 3}} - {x_{i, 4}})/2}\\ {{X_i}(2:2: \mathit{row} , 1:2: \mathit{col} ) = ({x_{i, 1}} - {x_{i, 2}} + {x_{i, 3}} - {x_{i, 4}})/2}\\ {{X_i}(2:2: \mathit{row} , 1:2: \mathit{col} ) = ({x_{i, 1}} + {x_{i, 2}} + {x_{i, 3}} + {x_{i, 4}})/2} \end{array}} \right. $ | (6) |

可以看到, 对于图像与第一个滤波器的卷积操作(Xi ⊗ ψLL), 实际上是求和池化操作, 得到的是低频带的图像信号。当输入所有的子带图像后, 输入信息中包含图像所有频带信号, 因此能够避免图像信息的丢失, 有利于提高图像恢复效果。

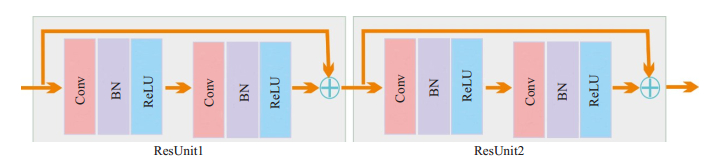

1.2.2 残差块结构如图 2所示, MWResNet网络采用的残差块结构由两个相同的残差单元组成, 每个残差单元分别由两个卷积单元组成, 而每个卷积单元包含一个卷积层(Conv), 一个批正则化层(BN)和一个线性整流函数(ReLU)激活层。与文献[26]提出的残差结构类似, 两个残差单元之间利用shortcut连接, 将单个残差单元的输入加到输出上, 实现残差补偿, 提高网络训练效率。得益于残差块的采用, MWResNet网络能构造更深的网络结构, 同时避免出现梯度消失的问题。

|

图 2 残差块结构 Fig.2 Structure of the residual block. |

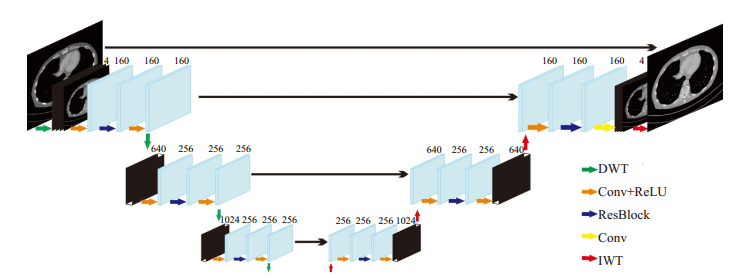

如图 3所示, MWResNet网络由图像分解网络和图像融合网络两部分组成。每一级分解网络包含一层DWT变换层和一个分解网络块。DWT对输入图像进行分解, 得到的全部子带特征图像再输入到分解网络块中, 提取粗尺度上的特征信息。分解网络块由卷积块, 残差块和卷积块组成, 其中一个卷积块包含一层卷积层(Conv)和一层线性整流函数(ReLU)。而残差块结构组成如图 2中所示。而每一级图像融合网络包含一个重建网络块和一层IWT变换层。重建网络块组成与分解网络块相似, 由卷积块, 残差块和卷积块三部分组成。不同的是在第一级重建网络块中最后一个卷积块只包含一个Conv卷积层, 无ReLU激活层。IWT则对重建网络块的输出融合升采样。

|

图 3 MWResNet网络模型框架 Fig.3 Framework of MWResNet network model. |

MWResNet网络通过不同等级的小波变换获得不同频率, 不同尺度上的特征结构, 进而更全面地刻画输入的低分辨率图像与对应高分辨率图像的映射关系。同时, 利用小波变换的正交性, 输入图像经过多级DWT和IWT后图像信息保持完整, 有效避免一般网络训练因为降采样操作导致的信息丢失问题。另外, MWResNet网络对图像分解和图像融合两部分网络采用加和(Summation)结构连接, 将上一级逆小波变换得到的融合图像加上当前级对应分解网络输出的特征图像, 用和图像作为当前级重建网络块的输入。实现图像特征共享, 网络参数重用, 有效提高网络训练的效率。

MWResNet网络分成多个级来实现图像特征提取和映射, 以三级网络为例。当输入图像进入第一级分解网络, 首先采用DWT进行第一级分解, 得到不同频率结构信息的第一级小波子带图像。然后全部子带图像输入到第一级分解网络块进行粗尺度结构特征提取, 输出的第一级特征图像全部输入到第二级分解网络中, 采用DWT进行第二级分解, 得到的第二级小波子带图像再输入到第二级分解网络块中。以此类推, 获得第二级特征图像和第三级特征图像, 实现细尺度精细结构上的特征提取。当得到第三级特征图像后开始进入图像融合网络, 将第三级特征图像输入到第三级重建网络块中进行特征映射。然后将其输出特征图像采用IWT进行特征融合得到的第三级重建图像。再将第三级融合图像加上第二级分解网络块输出的第二级特征图像, 用和图像作为第二级重建网络块的输入。以此类推, 获得第一级重建图像和最终特征融合输出的恢复图像。

2 实验 2.1 实验设计和网络参数选择实际上, 当前医用CT机并未配备稀疏角度扫描协议, 但是我们可以通过全角度投影数据仿真出稀疏角度数据, 即对采集获得的全角度数据进行降采样。因此, 为了评估所提出的深度多尺度小波残差网络(MWResNet)的性能, 本文采用"2016 Clinic Low Dose CT_Grand Challenge"公开数据集进行实验。该数据集包含10例由西门子64排CT机(Definition AS+)扫描得到的临床病人投影数据, 均采用Z轴方向飞焦点的螺旋扫描协议, 也就是每圈曝光2304个投影(而标准无飞焦点扫描则是每圈1152个投影)。对每圈2304投影的全角度投影数据进行8倍和16倍降采样, 可以分别得到每圈288和每圈144投影的稀疏角度数据。随后, 对所获得的稀疏角度投影采用螺旋FBP算法[27]进行重建, 最终得到待恢复的稀疏角度CT图像。

在训练MWResNet网络时, 为保证网络测试结果的公正有效, 挑选数据时遵循交叉验证原则。从10例患者图像集中随机挑选8例的全角度图像和对应的稀疏角度图像作为网络的输入, 剩下的2例患者图像集作为测试集。

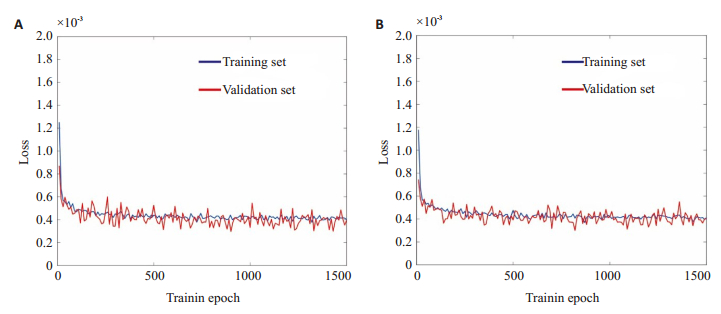

最优的网络参数是通过网络迭代实现最小化公式(3)对应的损失函数得到。网络中所有卷积层卷积核大小为3×3, 采用文献[27]所提出的方法进行网络参数的初始化有助于加快迭代的收敛。MWResNet网络的训练次数epoch为4000, 采用RMSprop优化算法寻找最优参数[28], 其中学习率lr为0.00 002, 每迭代1000次, 学习率调整为lr=lr ×0.5, 动量为0.9。我们利用pytorch框架构建MWResNet网络, 训练时使用GPU(NVIDIA TESLA P40, 显存为256 GB)进行加速, 训练时间为5个小时。训练过程的损失曲线如图 4所示, 可以看到MWResNet网络在迭代200步左右逐渐收敛, 此后训练集和验证集的损失基本都在[4×10-4, 6×10-4]这个区间内上下波动, 收敛趋于稳定。

|

图 4 训练阶段MWResNet网络对于(A)输入为8倍降采样稀疏角度图像及(B)输入为16倍降采样的稀疏角度图像在训练集和验证集上的损失曲线 Fig.4 Loss curves of the training set and the verification set of MWResNet network training using input images of 8 times downsampled sparse view (A) and 16 times downsampled sparse view (B). |

为了对比本文的MWResNet网络与现有的图像恢复网络对8倍降采样和16倍降采样两类稀疏角度CT图像的恢复效果, 本文采用三种定量分析矩阵表征不同网络的输出效果。

作为对比的CT图像恢复网络为图像恢复迭代残差卷积网络(IRLNet), 残差编码解码卷积神经网络(REDCNN)和FBP卷积神经网络(FBPConvNet)。三种定量分析矩阵分别为峰值信噪比(PSNR), 归一化均方根误差(NMSE)和特征相似度(FSIM)[29]。

| $ MSE = \frac{1}{{mn}}\mathop \sum \limits_{i = 0}^{m - 1} \mathop \sum \limits_{j = 0}^{n - 1} {[Y(i, j) - X(i, j)]^2} $ | (7) |

其中Y表示全角度下的CT图像(真值), X表示不同网络输出的恢复图像。

| $ PSNR = 20 \cdot {\rm{lo}}{\rm{g}_{10}}(\frac{{MAX}}{{\sqrt {MSE} }}) $ | (8) |

其中MAX为真值图像中的最大值。

| $ NMSE = \frac{{\sum\limits_{i = 0}^{m - 1} {\sum\limits_{j = 0}^{n - 1} {{{[Y(i, j) - X(i, j)]}^2}} } }}{{\sum\limits_{i = 0}^{m - 1} {\sum\limits_{j = 0}^{n - 1} {{{[Y(i, j)]}^2}} } }} $ | (9) |

| $ FSIM = \frac{{\mathop \sum \nolimits_x {S_L}(x) \cdot P{C_m}(x)}}{{\mathop \sum \nolimits_x P{C_m}(x)}} $ | (10) |

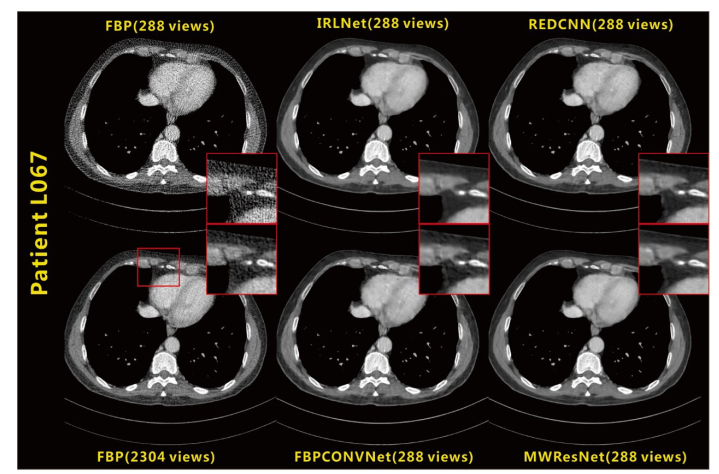

图 5展示用8倍降采样稀疏角度数据重建的胸腔图像作为不同网络模型的输入得到的恢复结果。结合图中红色矩形框细节图像可知, 常规FBP重建得到的稀疏角度图像存在明显的噪声和伪影。IRLNet网络的输出图像有些过平滑, REDCNN结果组织边缘有些模糊, 而FBPCONVNet网络结果在心肌组织等部分均匀区域存在较明显的伪影, 本文MWResNet网络的图像中边缘清晰, 无明显噪声和伪影。

|

图 5 用8倍降采样稀疏角度投影重建胸腔图像作为不同网络模型为输入得到的恢复结果 Fig.5 Output recovery results of different network models using 8 times downsampling sparse view reconstructed chest images as the input. The red rectangle shows the details of the area of interest. The display window uses[-240, 360] HU. |

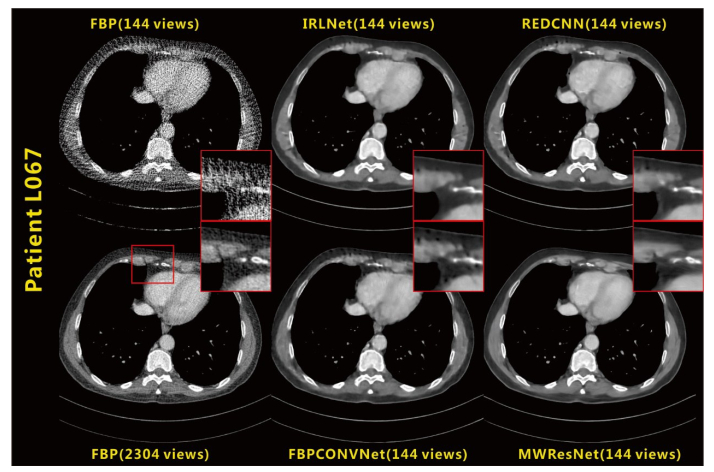

图 6显示用16倍降采样稀疏角度数据重建的胸腔图像作为不同网络模型的输入得到的恢复结果。可以看到, 常规FBP重建的稀疏角度图像中存在严重的噪声和伪影, 难以识别组织的细节结构信息。IRLNet网络结果显示噪声和伪影大幅减少, 但在细节图中可以看到胸壁侧肌肉边缘存在锯齿状伪影。而且下方的骨头连接成块, 明显不同于参考图像中的分离式骨头结构。REDCNN网络图像中噪声和伪影明显减少, 但是在细节图胸壁侧肌肉边缘同样存在锯齿状伪影, 不过下方的骨头连接程度降低了。FBPConvNet网络图像边缘模糊, 平滑过度, 而且在近心胸壁侧存在明显的伪影。本网络MWResNet图像噪声和伪影显著减少, 组织边缘结构清晰, 细节图中骨结构与参考图像基本接近, 没有引入新的伪影。

|

图 6 用16倍降采样稀疏角度投影重建胸腔图像作为不同网络模型为输入得到的恢复结果 Fig.6 Output recovery results of different network models using 16 times downsampling sparse view reconstructed chest images as the input. The red rectangle shows the details for the area of interest. The display window uses[-240, 360] HU. |

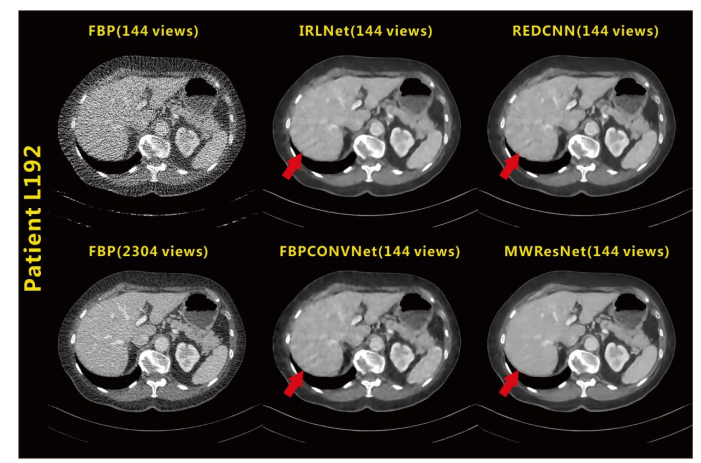

图 7展示了不同网络方法对同一个病人16倍降采样稀疏角度数据重建的腹部图像的恢复结果。对比红色箭头处肝部组织边缘的恢复效果, IRLNet图像存在部分相间的暗带伪影, REDCNN结果噪声和暗带伪影都较明显, FBPCONVNet图像平滑过度, 边缘细节模糊, 而且肝部邻近胸壁处放射状伪影较明显, 本文提出的MWResNet结果无明显噪声和伪影, 组织边缘细节清晰。

|

图 7 用16倍降采样稀疏角度投影重建腹部图像作为不同网络模型为输入得到的恢复结果 Fig.7 Output recovery results of different network models using 16 times downsampling sparse view reconstructed abdomen images as the input. The display window uses[-140, 260] HU. |

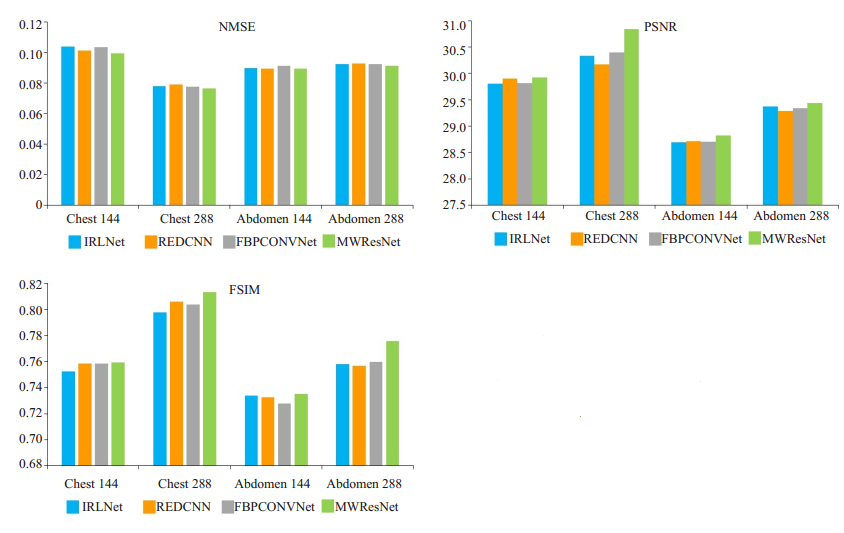

图 8中展示了三种定量分析矩阵PSNR, NMSE和FSIM对于不同网络模型恢复图像的定量分析结果。网络的输入分别为8倍降采样稀疏角度数据重建的胸腔图像和腹部图像, 以及16倍降采样稀疏角度数据重建的胸腔图像和腹部图像。由图可知, 与其他网络结果相比, 本网络MWResNet恢复结果的NMSE值最小, PSNR值和FSIM值最高。

|

图 8 三种定量分析矩阵PSNR, NMSE和FSIM对于不同网络模型恢复图像的定量分析结果 Fig.8 Results of quantitative analysis by the 3 quantitative analysis matrices PSNR, NMSE and FSIM for the restored images by different network models. The inputs of the network are the reconstruction of the chest and abdomen with 8 times down sampling and 16 times of downsampling. |

不同网络方法处理599层512×512的稀疏角度图像数据, 所需时间如表 1所示。全角度的FBP重建所用时间为167.3 s, 16倍降采样稀疏角度重建的时间为36.1 s, 其中总时间为重建时间加上网络恢复时间。本文MWResNet网络进行稀疏角度图像恢复的时间为76.3 s, FBPConvNet网络所用时间最少, 为72.1 s, REDCNN网络用时则最多, 为227.5 s。

| 表 1 不同网络恢复时间对比 Tab.1 Comparison of time consumption of different network recovery |

图 5结果显示, 对于稀疏程度并不高的8倍降采样稀疏角度重建图像, 不同网络方法的恢复效果在提升图像分辨率上并没有体现较大的差异。然而, 当网络的输入为稀疏程度更高的16倍降采样重建图像时, 从图 6结果所示, 本网络MWResNet的恢复结果相比于其他网络的结果, 能明显降低图像噪声和伪影的同时不会引入新的伪影。考虑到人体不同部位组织差异较大, 图 7显示不同网络方法对于另一个部位的稀疏角度重建腹部图像的恢复效果, 其他网络的恢复结果存在结构细节模糊和图像失真的情况, 而本网络MWResNet实现图像恢复同时能够保证不会造成图像的失真。图 8中的定量分析表明, 本网络MWResNet恢复图像的噪声水平最低, 图像分辨率最高。与参考图像的图像相似性最大, 表明组织细节信息能够有效保持。并且, 对比表 1中不同网络进行恢复所用时间可知, 本网络MWResNet所用时间与最少时间的FBPConvNet网络相差4 s, 表明能够在有效恢复稀疏角度图像分辨率的同时兼顾效率。

稀疏角度CT是一种有效降低辐射剂量的成像模式, 但是一直以来缺乏高效的算法解决稀疏角度图像中的伪影问题, 特别是对于高稀疏数据, 因此无法广泛地进行推广应用。受启发于一种图像恢复的混合神经网络模型, 该模型结合传统优化模型和神经网络的优点, 获得良好的图像恢复效果, 本文提出一种基于深度多尺度小波残差网络(MWResNet)实现稀疏角度CT图像恢复。将稀疏角度图像与对应全角度的重建图像输入到该网络中, 通过网络训练学习出从稀疏角度图像变换到对应的全角度图像的映射函数, 实现稀疏角度图像噪声减少、伪影的去除, 获得高分辨率的恢复图像。

从图像显示效果以及后面的分析讨论结果上看, 与IRLNet, REDCNN和FBPConvNet等现有的CT图像恢复网络相比, 本文提出的MWResNet网络能够有效减少稀疏角度图像的噪声和伪影, 提高组织边缘对比度, 得到尽可能无失真的恢复图像。

本文提出的稀疏角度CT图像恢复网络MWResNet网络稀疏角度CT模型的优点与不足。优点是:(1)采用多尺度小波变换及其逆小波变换实现数据的升采样和降采样, 区别于传统的神经网络利用卷积层和反卷积层实现。图像中一些重要的细节信息会在卷积操作中丢失, 因而传统的全连接卷积神经网络[30-32]的卷积层数目一般不超过5层。本文网络利用小波变换的正交性, 保证了图像输入到分解网络和重建网络过程中信息的完整性。而且, 网络利用多尺度的小波分解实现图像不同频率细节信息的提取, 在精细结构层面实现特征映射, 提高输出图像保真度; (2)采用残差卷积块。残差卷积块作为网络分解和重建过程中主要的组成成分, 对多尺度小波变换得到的子带图像实现特征提取和特征映射。残差卷积块的作用一是可以防止网络结构过深出现的梯度消失问题[32]。二是可以缩短网络训练时间, 加快网络训练效率。因为与直接使网络映射输出接近一个真值相比, 残差卷积块更容易找到一组参数使得网络的映射输出接近0;(3)采用加和(Summation)连接。每一级重建网络块的输入是一个和图像, 由上一级逆小波变换融合的重建图像加上当前级对应分解网络块的输出图像得到, 实现分解网络块和重建网络块的特征共享, 这样能够保持更多的结构信息以及降低网络的复杂度。

MWResNet网络模型的不足。从图 6中的16倍降采样稀疏角度恢复结果可以看到, 对于输入为高稀疏度图像, 网络的恢复结果在部分均匀区域有些过平滑, 在一些细节结构上与参考图像存在差异。表明MWResNet网络处理高稀疏程度输入图像, 存在将强伪影和高噪声形成的结构当作组织的固有结构的情况而映射到输出中。因此, 对于本文MWResNet网络仍然有需要继续改进以提升图像结果。

改进一是在小波变换采用的小波基函数上改进。本网络的二维离散小波变换的小波基函数采用的是Haar小波函数。考虑到人体组织结构的复杂性与多样性, 对不同人体部位的稀疏角度CT图像进行图像恢复时, 是否应采用不同小波基函数的小波变换构建分解网络和重建网络。后续的工作将探究网络中采用不同小波基函数进行小波变换与逆变换对稀疏角度图像恢复效果的影响。

改进二是在分解网络与重建网络级数上改进。本文网络中采用三级分解网络和重建网络对输入图像进行多尺度特征提取与映射。是否对于腹部等复杂结构CT图像采用更多级的网络级数来获取更多, 更细节的特征信息来构建恢复效果更佳的网络映射函数。后续的工作需要继续研究网络的级数对网络恢复效果的影响。

针对CT稀疏角度成像问题, 本文提出一种基于深度多尺度小波残差网络(MWResNet)模型实现稀疏角度CT图像的恢复。该网络模型结合了多尺度小波变换和残差网络的优点, 通过实验的定性分析和定量分析结果表明, 本网络能明显减少稀疏角度CT图像中的噪声和伪影, 同时能保持图像中组织结构的细节信息, 提高图像的分辨率。因此, 本文提出基于网络的稀疏角度图像恢复算法, 为实现低剂量成像提供一个有效的参考方案。

| [1] |

Pierce DA, Preston DL. Radiation-related cancer risks at low doses among atomic bomb survivors[J]. Radiat Res, 2000, 154(2): 178-86. DOI:10.1667/0033-7587(2000)154[0178:RRCRAL]2.0.CO;2 |

| [2] |

Brenner DJ, Hall EJ. Computed tomography--an increasing source of radiation exposure[J]. N Engl J Med, 2007, 357(22): 2277-84. DOI:10.1056/NEJMra072149 |

| [3] |

Tian Z, Jia X, Yuan K, et al. Low-dose CT reconstruction via edgepreserving total variation regularization[J]. Phys Med Biol, 2011, 56(18): 5949-67. DOI:10.1088/0031-9155/56/18/011 |

| [4] |

Sidky EY, Kao CM, Pan XC. Accurate image reconstruction from few-views and limited-angle data in divergent-beam CT[J]. J Xray Sci Technol, 2006, 14(2): 119-39. |

| [5] |

Bian JG, Siewerdsen JH, Han X, et al. Evaluation of sparse-view Reconstruction from flat-panel-detector cone-beam CT[J]. Phys Med Biol, 2010, 55(22): 6575-99. DOI:10.1088/0031-9155/55/22/001 |

| [6] |

Davison ME. The Ill-Conditioned Nature of the limited angle tomography problem[J]. SIAM JAppl Math, 1983, 43(2): 428-48. DOI:10.1137/0143028 |

| [7] |

Karimi D, Ward RK. Sinogram denoising via simultaneous sparse representation in learned dictionaries[J]. Phys Med Biol, 2016, 61(9): 3536-53. DOI:10.1088/0031-9155/61/9/3536 |

| [8] |

Li S, Cao Q, Chen Y, et al. Dictionary learning based sinogram inpainting for CT sparse Reconstruction[J]. Optik (Stuttg), 2014, 125(12): 2862-7. DOI:10.1016/j.ijleo.2014.01.003 |

| [9] |

Aharon M, Elad M, Bruckstein A. K-SVD: an algorithm for designing overcomplete dictionaries for sparse representation[J]. IEEE Trans Signal Process, 2006, 54(11): 4311-22. DOI:10.1109/TSP.2006.881199 |

| [10] |

Kwon H, Cho J, Oh J, et al. The adaptive statistical iterative reconstruction-V technique for radiation dose reduction in abdominal CT: comparison with the adaptive statistical iterative reconstruction technique[J]. Brit J Radiol, 2015, 88(154): 20150463. |

| [11] |

Volders D, Bols A, Haspeslagh M, et al. Model-based iterative reconstruction and adaptive statistical iterative reconstruction techniques in abdominal CT: comparison of image quality in the detection of colorectal liver metastases[J]. Radiology, 2013, 269(2): 468-73. |

| [12] |

Kim H, Chen J, Wang A, et al. Non-local total-variation (NLTV) minimization combined with reweighted L1-norm for compressed sensing CT Reconstruction[J]. Phys Med Biol, 2016, 61(18): 6878-91. DOI:10.1088/0031-9155/61/18/6878 |

| [13] |

Li ZB, Yu LF, Trzasko JD, et al. Adaptive nonlocal means filtering based on local noise level for CT denoising[J]. Med Phys, 2014, 41(1): 11908. |

| [14] |

Litjens G, Kooi T, Bejnordi B E, et al. A survey on deep learning in medical image analysis[J]. Med ImageAnal, 2017, 42: 60-88. |

| [15] |

Razzak MI, Naz S, Zaib A. Deep learning for medical image processing: overview, challenges and the future[M]. Classification in BioApps. Springer, Cham, 2018: 323-50.

|

| [16] |

Hatt M, Parmar C, Qi J, et al. Machine (deep) learning methods for image processing and radiomics[J]. IEEE Trans Radiat Plasma Med Sci, 2019, 3(2): 104-8. DOI:10.1109/TRPMS.2019.2899538 |

| [17] |

Jin KH, Mccann MT, Froustey E, et al. Deep convolutional neural network for inverse problems in imaging[J]. IEEE Trans Image Process, 2017, 26(9): 4509-22. DOI:10.1109/TIP.2017.2713099 |

| [18] |

Chen H, Zhang Y, Kalra MK, et al. Low-Dose CT with a residual Encoder-Decoder convolutional neural network[J]. IEEE Trans Med Imaging, 2017, 36(12): 2524-35. DOI:10.1109/TMI.2017.2715284 |

| [19] |

Liu P, Zhang H, Zhang K, et al. Multi-level wavelet-CNN for image restoration[C]. IEEE Conf Comput Vis Pattern Recognit, 2018: 773- 82.

|

| [20] |

Ronneberger O, Fischer P, Brox T. U-Net: convolutional networks for biomedical image segmentation[C]. Med. Image Comput. Comput.-Assisted Intervention, 2015: 234-41.

|

| [21] |

Wang Y, Liao Y, Zhang Y, et al. Iterative quality enhancement via residual-artifact learning networks for low-dose CT[J]. Phys Med Biol, 2018, 63(21): 215004. DOI:10.1088/1361-6560/aae511 |

| [22] |

Kang E, Min JH, Ye JC. A deep convolutional neural network using directional wavelets for low-dose X-ray CT Reconstruction[J]. Med Phys, 2017, 44(10): e360-75. DOI:10.1002/mp.12344 |

| [23] |

Hornik K, Stinchcombe M, White H. Multilayer feedforward networks are Universal approximators[J]. Neural Networks, 1989, 2(5): 359-66. DOI:10.1016/0893-6080(89)90020-8 |

| [24] |

Cheng B, Tong H. A theory of wavelet representation and decomposition for a general stochastic process[J]. Athens Conference on Applied Probability and Time Series Analysis. Springer, New York, NY, 1996: 115-29.

|

| [25] |

Mallat SG. A theory for multiresolution signal decomposition: the wavelet representation[J]. IEEE Trans. Pattern Anal. Machine Intell, 1989(7): 674-93. |

| [26] |

He KM, Zhang XY, Ren SQ, et al. Deep residual learning for image recognition[C]. IEEE Conf. Comput. Vis Pattern Recognit, 2016: 770-8.

|

| [27] |

Stierstorfer K, Rauscher A, Boese J, et al. Weighted FBP-a simple approximate 3D FBP algorithm for multislice spiral CT with good dose usage for arbitrary pitch[J]. Phys Med Biol, 2004, 49(11): 2209-18. DOI:10.1088/0031-9155/49/11/007 |

| [28] |

Kingma, DP, Ba JL. Adam: A method for stochastic optimization[C]. International Conference on Learning Representations, 2015: 1-15.

|

| [29] |

Zhang L, Zhang L, Mou X, et al. FSIM: a feature similarity index for image quality assessment[J]. IEEE Trans Image Process, 2011, 20(8): 2378-86. DOI:10.1109/TIP.2011.2109730 |

| [30] |

Xu L, Ren JSJ, Liu C, et al. Deep convolutional neural network for image deconvolution[C]. Advances in neural information processing systems. 2014: 1790-8.

|

| [31] |

Shelhamer E, Long J, Darrell T. Fully convolutional networks for semantic segmentation[J]. IEEE Trans Pattern Anal Mach Intell, 2017, 39(4): 640-51. DOI:10.1109/TPAMI.2016.2572683 |

| [32] |

Jain V, Seung S. Natural image denoising with convolutional networks [C]. Advances in neural information processing systems. 2009: 769- 76.

|

2019, Vol. 39

2019, Vol. 39